-

-

December 11, 2024 at 9:04 am

-

December 12, 2024 at 12:32 pm

GuanYo Dong

Subscriber你好

Getting Started with lumopt - Python API – Ansys Optics

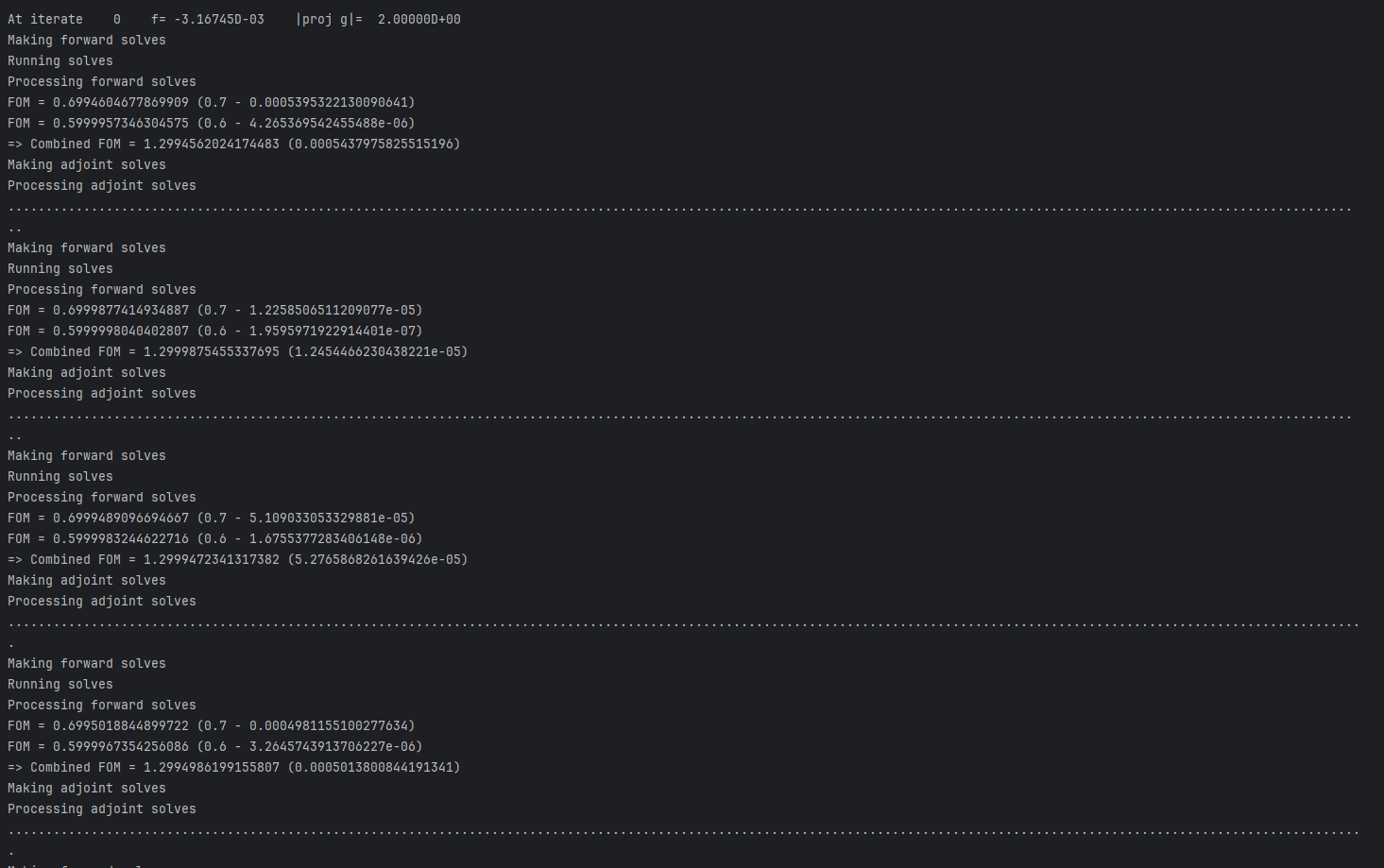

從這個參考資料來看,我用2D的案例測試,案例只有第0次疊代會發生多次forward計算(4次),

在我看來這是在測試各參數跟FOM的相關性以便之後疊代改變做為參考,

在第0次疊代找到比初值好的FOM的時候才會停止forward計算進入下一次疊代

而用案例測試

改變scale_initial_gradient_to 以及scaling_factor會影響forward的次數,但是也會影響優化的成效

根據網址的說明,

scale_initial_gradient_to 意思是如果我們知道哪個變量本來就比較強相關,可以相比其他參數讓他的權重較大,相當於給優化函數一個提示

scaling_factor 意思是讓每個參數的step可以不同

所以如果您的例子發生第0次疊代很久,

可以將初值設定低一些,也可以改變兩個scaling參數給軟件一些操作提示

莎益博,董冠佑 -

December 12, 2024 at 12:38 pm

GuanYo Dong

Subscriber你好

也有可能初值已經在一個局部極值或是真的最佳值了

此時也會建議改變那兩個scaling的參數讓搜索範圍離開局部遠一些做探索

莎益博, 董冠佑 -

December 13, 2024 at 8:17 am

2971462718

Subscriber知道了,谢谢老师,我去试试

-

December 14, 2024 at 8:12 am

2971462718

Subscriber老师我试了下,这个scaling_initial_gradient_to是个标量吧,怎么说是对哪个变量调权重,我还是不懂这个调大调小的区别?

-

December 19, 2024 at 4:26 am

GuanYo Dong

Subscriber你好

不好意思我重新看了說明

他的意思是,第一次盲選要符合,對優化值的影響程度的最小量

找到一次改變就可以提升10%的方向,跟找到5%提升就好的難度不同,也可能導致找了不同的方向

比如A跟B參數都可以做到5%以上提升,但是只有A參數可以做到10%,要找到A的代價有可能就是更多次的尋找

改成5%我們不確定找到的是A或是B,要是選到B可能我們就無法找到最好的情況了所以影響最後的成果

但確實可以減少一些第一次疊代的次數莎益博 董冠佑

-

- You must be logged in to reply to this topic.

-

5964

-

1906

-

1420

-

1307

-

1021

© 2026 Copyright ANSYS, Inc. All rights reserved.